人工智能(AI)的迅猛發(fā)展,尤其是以深度學(xué)習(xí)為代表的神經(jīng)網(wǎng)絡(luò)技術(shù),正深刻改變著世界。這背后,離不開一套堅(jiān)實(shí)、高效、可擴(kuò)展的基礎(chǔ)設(shè)施作為支撐。人工智能神經(jīng)網(wǎng)絡(luò)基礎(chǔ)設(shè)施,連同其核心的基礎(chǔ)軟件開發(fā),共同構(gòu)成了驅(qū)動(dòng)AI創(chuàng)新與應(yīng)用落地的核心引擎。

一、人工智能神經(jīng)網(wǎng)絡(luò)基礎(chǔ)設(shè)施的核心構(gòu)成

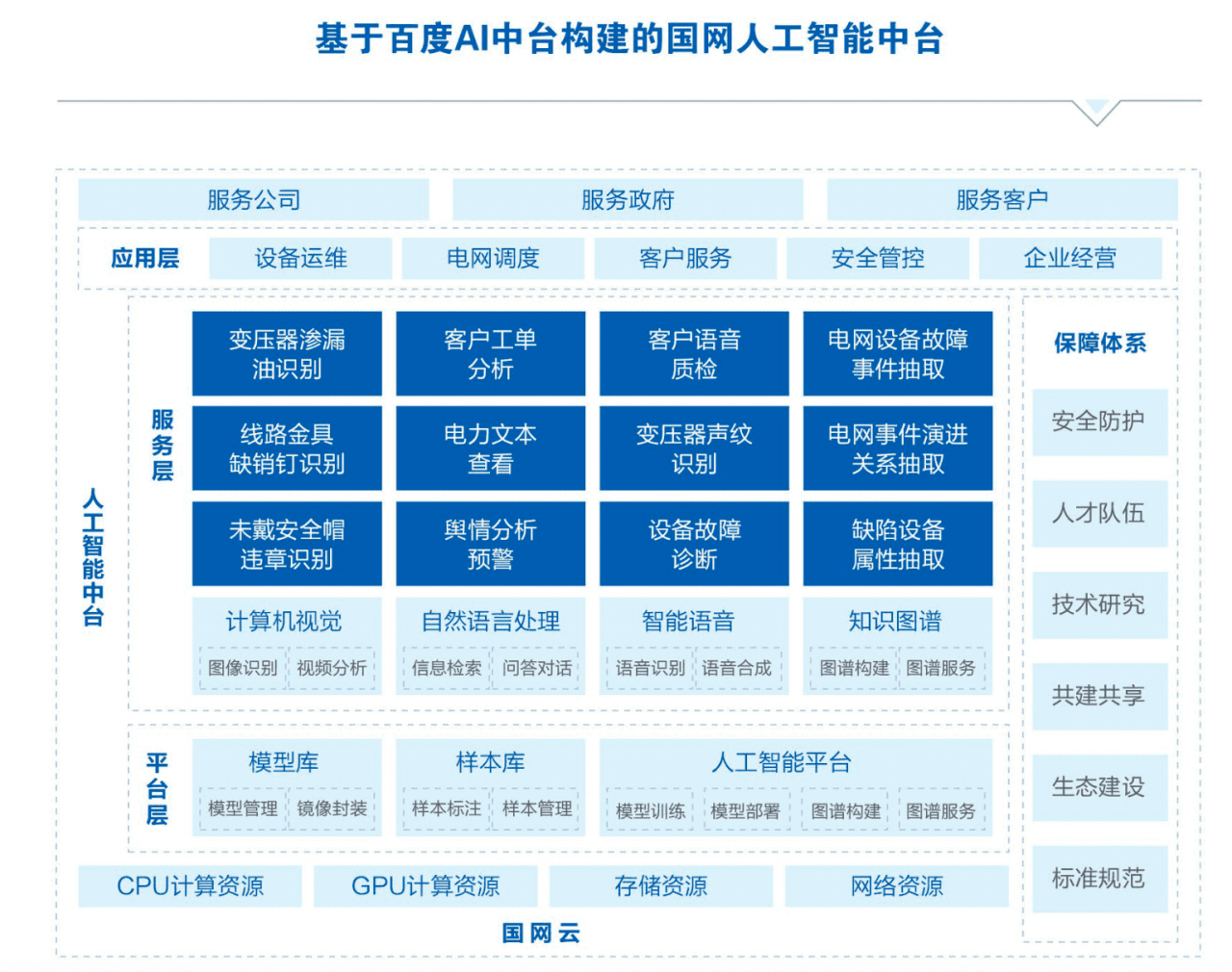

人工智能神經(jīng)網(wǎng)絡(luò)基礎(chǔ)設(shè)施并非單一組件,而是一個(gè)多層次、協(xié)同工作的復(fù)雜技術(shù)棧體系。其核心構(gòu)成可以概括為以下幾個(gè)層面:

1. 硬件計(jì)算層:算力的物理基石

這是基礎(chǔ)設(shè)施的最底層,負(fù)責(zé)提供原始計(jì)算能力。其核心已經(jīng)從傳統(tǒng)的CPU轉(zhuǎn)向了更適合大規(guī)模并行矩陣運(yùn)算的GPU(圖形處理器),以及更專業(yè)的AI加速芯片,如TPU(張量處理單元)、NPU(神經(jīng)網(wǎng)絡(luò)處理單元)和各類ASIC(專用集成電路)。高性能計(jì)算集群、高速互聯(lián)網(wǎng)絡(luò)(如NVLink、InfiniBand)和超大規(guī)模數(shù)據(jù)中心,共同構(gòu)成了支撐萬億參數(shù)大模型訓(xùn)練的物理基礎(chǔ)。

2. 框架與平臺(tái)層:開發(fā)的抽象與賦能

這一層將底層硬件的復(fù)雜性隱藏起來,為算法開發(fā)者和數(shù)據(jù)科學(xué)家提供高效的編程接口和工具。主要包括:

- 深度學(xué)習(xí)框架:如TensorFlow、PyTorch、PaddlePaddle等。它們提供了構(gòu)建、訓(xùn)練和部署神經(jīng)網(wǎng)絡(luò)模型所需的核心庫(kù)和高級(jí)API,實(shí)現(xiàn)了自動(dòng)微分、動(dòng)態(tài)計(jì)算圖等功能,極大降低了開發(fā)門檻。

- 分布式訓(xùn)練平臺(tái):為了應(yīng)對(duì)海量數(shù)據(jù)和龐大模型,需要將訓(xùn)練任務(wù)分布式地部署到成百上千的加速卡上。平臺(tái)負(fù)責(zé)任務(wù)調(diào)度、數(shù)據(jù)并行/模型并行策略、梯度同步與通信優(yōu)化,以最大化集群利用率和訓(xùn)練速度。

- 數(shù)據(jù)與資源管理層:智能的“燃料”與“調(diào)度中心”

- 數(shù)據(jù)管道與存儲(chǔ):高質(zhì)量、大規(guī)模的數(shù)據(jù)是訓(xùn)練AI模型的“燃料”。基礎(chǔ)設(shè)施需要提供高效的數(shù)據(jù)采集、清洗、標(biāo)注、版本管理和存儲(chǔ)系統(tǒng)(通常基于對(duì)象存儲(chǔ)或分布式文件系統(tǒng)),確保數(shù)據(jù)能高速、穩(wěn)定地供給計(jì)算單元。

- 資源管理與調(diào)度系統(tǒng):如Kubernetes及其針對(duì)AI任務(wù)的擴(kuò)展(如Kubeflow),負(fù)責(zé)在異構(gòu)的計(jì)算集群中高效調(diào)度訓(xùn)練任務(wù)和推理服務(wù),管理計(jì)算、存儲(chǔ)和網(wǎng)絡(luò)資源,保障服務(wù)的穩(wěn)定性和資源利用率。

4. 模型部署與服務(wù)體系:從訓(xùn)練到應(yīng)用的橋梁

訓(xùn)練好的模型需要被部署到生產(chǎn)環(huán)境中提供服務(wù)。這一層包括:

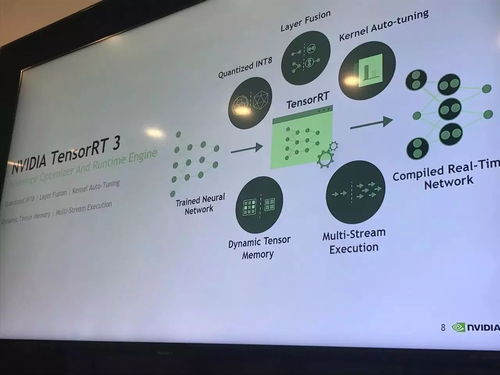

- 模型轉(zhuǎn)換與優(yōu)化:將框架訓(xùn)練的模型轉(zhuǎn)換為適合特定硬件(如移動(dòng)端、邊緣設(shè)備)的高效格式(如ONNX),并進(jìn)行剪枝、量化等優(yōu)化以壓縮模型、提升推理速度。

- 推理服務(wù)引擎:如TensorFlow Serving、Triton Inference Server等,提供高并發(fā)、低延遲的模型推理API服務(wù),并支持模型熱更新、版本管理和監(jiān)控。

- MLOps平臺(tái):將機(jī)器學(xué)習(xí)生命周期的管理(從實(shí)驗(yàn)、訓(xùn)練、評(píng)估到部署、監(jiān)控、迭代)流程化和自動(dòng)化,是實(shí)現(xiàn)AI項(xiàng)目規(guī)模化、可持續(xù)運(yùn)營(yíng)的關(guān)鍵。

二、人工智能基礎(chǔ)軟件開發(fā)的核心要義

基礎(chǔ)軟件開發(fā)是讓上述基礎(chǔ)設(shè)施“活”起來、發(fā)揮效能的關(guān)鍵。其核心目標(biāo)在于提升效率、降低復(fù)雜度、保證穩(wěn)定與可擴(kuò)展。重點(diǎn)領(lǐng)域包括:

- 高性能計(jì)算庫(kù)開發(fā):如針對(duì)特定AI芯片優(yōu)化的線性代數(shù)庫(kù)(BLAS)、深度學(xué)習(xí)算子庫(kù)(如cuDNN for NVIDIA, oneDNN for Intel)。這些底層軟件直接決定了硬件算力能發(fā)揮出幾成,是性能極致優(yōu)化的主戰(zhàn)場(chǎng)。

- 框架內(nèi)核與編譯器技術(shù):深度學(xué)習(xí)框架的核心是計(jì)算圖表示與執(zhí)行引擎。開發(fā)高效的靜態(tài)/動(dòng)態(tài)圖編譯器(如XLA、TorchScript),能夠?qū)τ?jì)算圖進(jìn)行融合、優(yōu)化,并生成高效的底層代碼,是提升訓(xùn)練和推理性能的根本。

- 分布式系統(tǒng)軟件:開發(fā)高效的通信庫(kù)(如NCCL、gRPC)以實(shí)現(xiàn)GPU間或節(jié)點(diǎn)間的快速梯度同步;設(shè)計(jì)魯棒的容錯(cuò)與彈性調(diào)度算法,以應(yīng)對(duì)大規(guī)模分布式訓(xùn)練中可能出現(xiàn)的節(jié)點(diǎn)故障。

- 工具鏈與生態(tài)建設(shè):開發(fā)可視化工具(如TensorBoard)、調(diào)試器、性能剖析器、自動(dòng)化調(diào)參工具等,提升研發(fā)和運(yùn)維體驗(yàn)。構(gòu)建豐富的模型庫(kù)、預(yù)訓(xùn)練模型和開源項(xiàng)目生態(tài),促進(jìn)知識(shí)共享和協(xié)作。

三、核心挑戰(zhàn)與未來趨勢(shì)

當(dāng)前,AI基礎(chǔ)設(shè)施與軟件開發(fā)面臨諸多挑戰(zhàn):極致性能與成本的平衡、超大模型帶來的存儲(chǔ)與通信瓶頸、異構(gòu)計(jì)算環(huán)境下的統(tǒng)一編程與管理、安全隱私與可信AI的需求日益迫切。

未來趨勢(shì)將圍繞以下方向演進(jìn):

- 軟硬件協(xié)同設(shè)計(jì):從專用AI芯片到與之深度綁定的系統(tǒng)軟件和框架,實(shí)現(xiàn)全棧優(yōu)化。

- 云邊端一體化:基礎(chǔ)設(shè)施將無縫覆蓋云端、邊緣和終端設(shè)備,支持模型的協(xié)同訓(xùn)練與推理。

- AI for AI:利用AI技術(shù)(如強(qiáng)化學(xué)習(xí))來自動(dòng)優(yōu)化神經(jīng)網(wǎng)絡(luò)架構(gòu)、超參數(shù)乃至基礎(chǔ)設(shè)施本身的配置與調(diào)度。

- 綠色與普惠AI:追求更高的能效比,并通過更易用的開發(fā)工具和平臺(tái),降低AI技術(shù)的應(yīng)用門檻。

###

人工智能神經(jīng)網(wǎng)絡(luò)基礎(chǔ)設(shè)施及其基礎(chǔ)軟件開發(fā),是支撐AI從學(xué)術(shù)研究走向千行百業(yè)應(yīng)用的“隱藏引擎”和“核心操作系統(tǒng)”。它不僅是技術(shù)實(shí)力的體現(xiàn),更是國(guó)家與企業(yè)在這場(chǎng)智能革命中構(gòu)建長(zhǎng)期競(jìng)爭(zhēng)力的戰(zhàn)略制高點(diǎn)。持續(xù)投入與創(chuàng)新于這一核心領(lǐng)域,才能確保我們?cè)谥悄軙r(shí)代擁有堅(jiān)實(shí)的地基,去筑就更加宏偉的AI大廈。